Es ist ein beunruhigendes Gefühl, wenn man feststellt, dass eine winzige, übersehene Textdatei die SEO Ihrer Website heimlich sabotiert. Viele Website-Besitzer erkennen nicht, dass ein einfacher Fehler in ihrer robots.txt-Datei verhindern kann, dass Google ihre wichtigsten Inhalte findet.

Nach der Überprüfung Tausender von WordPress-Websites haben wir dies öfter erlebt, als wir zählen können. Die gute Nachricht ist, dass die Behebung einfacher ist, als Sie denken.

In diesem Leitfaden führen wir Sie durch die genauen, praxiserprobten Schritte, die wir zur Optimierung einer WordPress robots.txt-Datei verwenden. Sie erfahren, wie Sie sie richtig einrichten und sicherstellen, dass Suchmaschinen Ihre Website effizient durchsuchen.

Fühlen Sie sich überfordert? Hier ist eine kurze Übersicht über alles, was wir in diesem Leitfaden behandeln werden. Springen Sie gerne zu dem Abschnitt, der Sie am meisten interessiert.

- Was ist eine robots.txt-Datei?

- Benötigen Sie eine Robots.txt-Datei für Ihre WordPress-Site?

- Wie sieht eine ideale robots.txt-Datei aus?

- So erstellen Sie eine Robots.txt-Datei in WordPress

- So testen Sie Ihre Robots.txt-Datei

- Abschließende Gedanken

- Häufig gestellte Fragen zu WordPress robots.txt

- Zusätzliche Ressourcen zur Verwendung von robots.txt in WordPress

Was ist eine robots.txt-Datei?

Robots.txt ist eine Textdatei, die Websitebesitzer erstellen können, um Suchmaschinen-Bots mitzuteilen, wie sie Seiten auf ihren Websites durchsuchen und indexieren sollen.

Sie ist normalerweise im Stammverzeichnis (auch Hauptordner genannt) Ihrer Website gespeichert. Das Grundformat einer robots.txt-Datei sieht wie folgt aus:

User-agent: [user-agent name]

Disallow: [URL string not to be crawled]

User-agent: [user-agent name]

Allow: [URL string to be crawled]

Sitemap: [URL of your XML Sitemap]

Sie können mehrere Zeilen mit Anweisungen haben, um bestimmte URLs zuzulassen oder zu verbieten und mehrere Sitemaps hinzuzufügen. Wenn Sie eine URL nicht verbieten, gehen Suchmaschinen-Bots davon aus, dass sie gecrawlt werden dürfen.

Hier ist ein Beispiel für eine robots.txt-Datei:

User-Agent: *

Allow: /wp-content/uploads/

Disallow: /wp-content/plugins/

Disallow: /wp-admin/

Sitemap: https://example.com/sitemap_index.xml

Im obigen robots.txt-Beispiel haben wir Suchmaschinen erlaubt, Dateien in unserem WordPress-Upload-Ordner zu crawlen und zu indexieren.

Danach haben wir Suchbots daran gehindert, Plugins und WordPress-Admin-Ordner zu crawlen und zu indizieren.

Zuletzt haben wir die URL unserer XML-Sitemap bereitgestellt.

Benötigen Sie eine Robots.txt-Datei für Ihre WordPress-Site?

Obwohl Ihre Website auch ohne eine robots.txt-Datei funktionieren kann, haben wir immer wieder festgestellt, dass Websites mit optimierten robots.txt-Dateien in den Suchergebnissen besser abschneiden.

Durch unsere Arbeit mit Kunden aus verschiedenen Branchen haben wir gesehen, wie ein ordnungsgemäßes Crawl-Budget-Management über robots.txt zu einer schnelleren Indizierung wichtiger Inhalte und einer besseren Gesamt-SEO-Leistung führen kann.

Verbinden Sie sich einfach mit den Dateien Ihrer WordPress-Website über einen FTP-Client.

Wenn Ihre Website jedoch wächst und Sie mehr Inhalte hinzufügen, möchten Sie wahrscheinlich eine bessere Kontrolle darüber haben, wie Ihre Website durchsucht und indexiert wird.

Hier ist der Grund.

Suchmaschinen weisen jeder Website ein von Google als „Crawl-Budget“ bezeichnetes Budget zu. Dies ist die Anzahl der Seiten, die sie innerhalb eines bestimmten Zeitraums crawlen werden.

Bei unseren Tests auf Tausenden von WordPress-Websites haben wir festgestellt, dass insbesondere größere Websites von der Optimierung dieses Budgets durch strategische robots.txt-Konfiguration profitieren.

Zum Beispiel verzeichnete einer unserer Unternehmenskunden eine Verbesserung der Crawleffizienz um 40 %, nachdem er unsere empfohlenen robots.txt-Optimierungen implementiert hatte.

Sie können Suchbots daran hindern, unnötige Seiten wie Ihre WordPress-Adminseiten, Plugin-Dateien und das Themes-Verzeichnis zu durchsuchen.

Indem Sie unnötige Seiten ablehnen, sparen Sie Ihr Crawl-Budget. Dies hilft Suchmaschinen, noch mehr Seiten auf Ihrer Website zu crawlen und sie so schnell wie möglich zu indexieren.

Ein weiterer guter Grund für die Verwendung einer robots.txt-Datei ist, wenn Sie verhindern möchten, dass Suchmaschinen einen Beitrag oder eine Seite auf Ihrer Website indexieren.

Es ist jedoch wichtig zu wissen, dass robots.txt nicht die beste Methode ist, um Inhalte zu verbergen. Eine blockierte Seite kann immer noch in den Suchergebnissen erscheinen, wenn sie von anderen Websites verlinkt wird.

Wenn Sie zuverlässig verhindern möchten, dass eine Seite bei Google erscheint, sollten Sie stattdessen ein 'noindex'-Meta-Tag verwenden. Dies weist Suchmaschinen an, die Seite überhaupt nicht in ihren Index aufzunehmen.

Wie sieht eine ideale robots.txt-Datei aus?

Viele beliebte Blogs verwenden eine sehr einfache robots.txt-Datei. Ihr Inhalt kann je nach den Bedürfnissen der spezifischen Website variieren:

User-agent: *

Disallow:

Sitemap: https://www.example.com/post-sitemap.xml

Sitemap: https://www.example.com/page-sitemap.xml

Diese robots.txt-Datei erlaubt allen Bots, alle Inhalte zu indexieren und stellt ihnen einen Link zu den XML-Sitemaps der Website zur Verfügung.

Für WordPress-Websites empfehlen wir die folgenden Regeln in der robots.txt-Datei:

User-Agent: *

Allow: /wp-content/uploads/

Disallow: /wp-admin/

Disallow: /readme.html

Disallow: /refer/

Sitemap: https://www.example.com/post-sitemap.xml

Sitemap: https://www.example.com/page-sitemap.xml

Dies weist Suchbots an, alle Ihre WordPress-Bilder und hochgeladenen Dateien zu indexieren, indem sie speziell die Allow-Direktive verwenden, ein hilfreicher Befehl, den Suchmaschinen wie Google verstehen.

Anschließend werden Suchbots daran gehindert, den WordPress-Adminbereich, die Standarddatei readme.html (die Ihre WordPress-Version preisgeben kann) und gängige Verzeichnisse für verschleierte Affiliate-Links wie /refer/ zu indexieren.

Durch das Hinzufügen von Sitemaps zur robots.txt-Datei erleichtern Sie es Google-Bots, alle Seiten Ihrer Website zu finden.

Die obigen Regeln gelten für alle Suchmaschinen-Crawler gleichzeitig. Sie können auch Regeln schreiben, die auf einen einzelnen Bot namentlich abzielen. Zum Beispiel können Sie auf diese Weise nur Googlebot daran hindern, einen bestimmten Ordner zu crawlen, während alle anderen Crawler weiterhin zugelassen werden:

User-agent: Googlebot

Disallow: /private/

User-agent: *

Allow: /Um einen bestimmten Crawler anzusprechen, ersetzen Sie das Platzhaltersymbol * durch seinen User-Agent-Namen. Gängige User-Agent-Namen sind Googlebot (Google), Bingbot (Bing) und Baiduspider (Baidu). Die meisten WordPress-Websites benötigen diese Spezifität nicht, aber sie ist nützlich, wenn Sie möchten, dass eine Suchmaschine einen Teil Ihrer Website überspringt, während andere darauf zugreifen können.

Jetzt, da Sie wissen, wie eine ideale robots.txt-Datei aussieht, sehen wir uns an, wie Sie eine robots.txt-Datei in WordPress erstellen können.

So erstellen Sie eine Robots.txt-Datei in WordPress

Es gibt zwei Möglichkeiten, eine robots.txt-Datei in WordPress zu erstellen. Sie können die Methode wählen, die für Sie am besten geeignet ist.

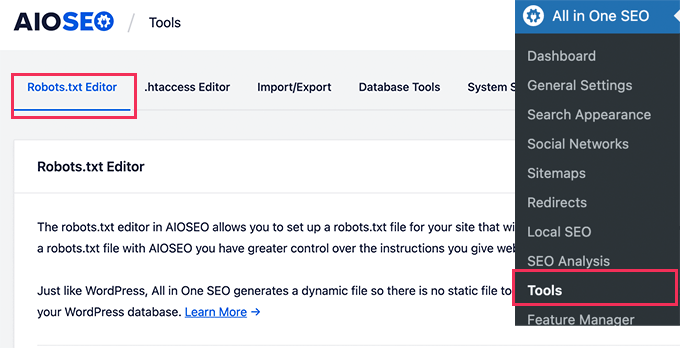

Methode 1: robots.txt-Datei mit All in One SEO bearbeiten

All in One SEO, auch bekannt als AIOSEO, ist das beste WordPress SEO-Plugin auf dem Markt und wird von über 3 Millionen Websites genutzt. Es enthält einen visuellen robots.txt-Editor mit einer Point-and-Click-Oberfläche, ohne dass eine Dateibearbeitung oder ein FTP-Zugriff erforderlich ist.

Der Editor validiert Ihre Regeln in Echtzeit und fängt Syntaxfehler ab, bevor Sie speichern. Das macht ihn zur anfängerfreundlichsten der drei Methoden.

Um mehr zu erfahren, lesen Sie unsere detaillierte AIOSEO-Bewertung.

Wenn Sie das AIOSEO-Plugin noch nicht installiert haben, finden Sie in unserer Schritt-für-Schritt-Anleitung, wie Sie ein WordPress-Plugin installieren.

Hinweis: Es gibt auch eine kostenlose Version von AIOSEO, die diese Funktion enthält.

Sobald das Plugin installiert und aktiviert ist, können Sie es verwenden, um Ihre robots.txt-Datei direkt aus Ihrem WordPress-Adminbereich zu erstellen und zu bearbeiten.

Gehen Sie einfach zu All in One SEO » Tools, um Ihre robots.txt-Datei zu bearbeiten.

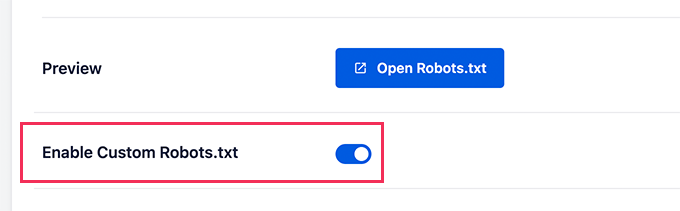

Zuerst müssen Sie die Bearbeitungsoption aktivieren, indem Sie den Schalter „Benutzerdefinierte Robots.txt aktivieren“ auf Blau stellen.

Mit diesem Schalter können Sie eine benutzerdefinierte robots.txt-Datei in WordPress erstellen.

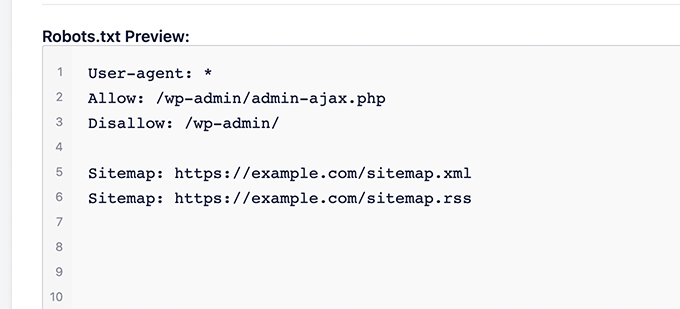

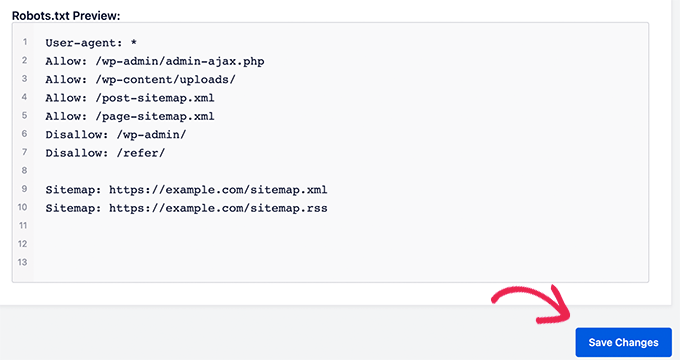

All in One SEO zeigt Ihre vorhandene robots.txt-Datei im Abschnitt „Robots.txt-Vorschau“ am unteren Bildschirmrand an.

Diese Version zeigt die Standardregeln an, die von WordPress hinzugefügt wurden.

Diese Standardregeln weisen die Suchmaschinen an, Ihre Kern-WordPress-Dateien nicht zu crawlen, die Bots zuzulassen, alle Inhalte zu indexieren, und ihnen einen Link zu den XML-Sitemaps Ihrer Website bereitzustellen.

Jetzt können Sie Ihre eigenen benutzerdefinierten Regeln hinzufügen, um Ihre robots.txt für SEO zu verbessern.

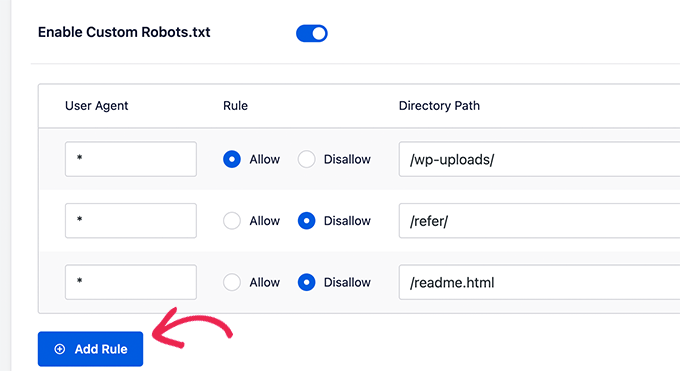

Um eine Regel hinzuzufügen, geben Sie einen User-Agenten in das Feld 'User Agent' ein. Die Verwendung eines * wendet die Regel auf alle User-Agents an.

Wählen Sie dann aus, ob Sie zulassen oder verbieten möchten, dass Suchmaschinen crawlen.

Geben Sie als Nächstes den Dateinamen oder den Verzeichnispfad in das Feld „Verzeichnispfad“ ein.

Die Regel wird automatisch auf Ihre robots.txt angewendet. Um eine weitere Regel hinzuzufügen, klicken Sie einfach auf die Schaltfläche „Regel hinzufügen“.

Wir empfehlen, Regeln hinzuzufügen, bis Sie das von uns oben geteilte ideale robots.txt-Format erstellt haben.

Der AIOSEO-Editor unterstützt auch User-Agent-spezifische Regeln. Anstatt * in das Feld User Agent einzugeben, geben Sie einen bestimmten Bot-Namen wie Googlebot oder Bingbot ein, um eine Regel zu erstellen, die nur für diesen Crawler gilt.

Hinweis: AIOSEO generiert auch eine llms.txt-Datei, die wie robots.txt funktioniert, aber für KI-Suchtools wie ChatGPT und Perplexity. Sie können beide Dateien über dasselbe AIOSEO-Dashboard verwalten.

Ihre benutzerdefinierten Regeln werden wie folgt aussehen.

Wenn Sie fertig sind, vergessen Sie nicht, auf die Schaltfläche 'Änderungen speichern' zu klicken, um Ihre Änderungen zu speichern.

Methode 2: Bearbeiten der robots.txt-Datei mit WPCode

WPCode ist ein leistungsstarkes Code-Snippet-Plugin, mit dem Sie einfach und sicher benutzerdefinierten Code zu Ihrer Website hinzufügen können.

Es enthält auch eine praktische Funktion, mit der Sie die robots.txt-Datei schnell bearbeiten können.

Hinweis: Es gibt auch ein WPCode Free Plugin, aber es enthält nicht die Dateieditor-Funktion.

Als Erstes müssen Sie das WPCode-Plugin installieren. Eine Schritt-für-Schritt-Anleitung finden Sie in unserem Anfängerleitfaden, wie Sie ein WordPress-Plugin installieren.

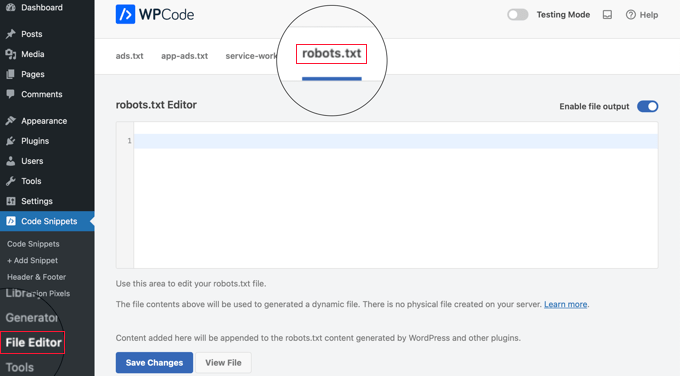

Nach der Aktivierung müssen Sie zur Seite WPCode » Dateieditor navigieren. Dort klicken Sie einfach auf den Reiter „robots.txt“, um die Datei zu bearbeiten.

Jetzt können Sie den Inhalt der robots.txt-Datei einfügen oder eingeben.

Hinweis: WPCode fügt Ihre Einträge zusätzlich zu den Standard-robots.txt-Regeln hinzu, die WordPress automatisch generiert. Es ersetzt diese Datei nicht vollständig. Wenn außerdem eine physische robots.txt-Datei in Ihrem Server-Stammverzeichnis vorhanden ist, kann WPCode diese nicht verwalten, bis Sie diese Datei zuerst entfernen.

Wenn Sie fertig sind, stellen Sie sicher, dass Sie auf die Schaltfläche „Änderungen speichern“ am unteren Rand der Seite klicken, um die Einstellungen zu speichern.

Methode 3: robots.txt-Datei manuell per FTP bearbeiten

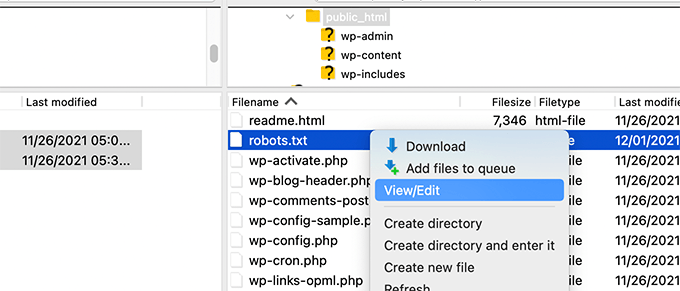

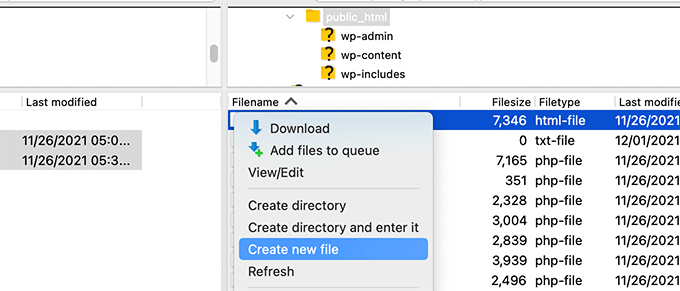

Für diese Methode müssen Sie einen FTP-Client verwenden, um die robots.txt-Datei zu bearbeiten. Alternativ können Sie den Dateimanager verwenden, der von Ihrem WordPress-Hosting bereitgestellt wird.

Profi-Tipp: Bevor Sie Änderungen vornehmen, empfehlen wir Ihnen, eine Sicherungskopie Ihrer ursprünglichen robots.txt-Datei (falls vorhanden) auf Ihren Computer herunterzuladen. So können Sie sie bei Problemen einfach wieder hochladen.

Verbinden Sie sich einfach mit den Dateien Ihrer WordPress-Website über einen FTP-Client.

Dort angekommen, können Sie die robots.txt-Datei in Ihrem Website-Stammordner sehen.

Wenn Sie keine sehen, haben Sie wahrscheinlich keine robots.txt-Datei.

In diesem Fall können Sie einfach fortfahren und eine erstellen.

Robots.txt ist eine reine Textdatei, was bedeutet, dass Sie sie auf Ihren Computer herunterladen und mit einem beliebigen Texteditor wie Notepad oder TextEdit bearbeiten können.

Nach dem Speichern Ihrer Änderungen können Sie die robots.txt-Datei zurück in den Stammordner Ihrer Website hochladen.

So testen Sie Ihre Robots.txt-Datei

Nachdem Sie Ihre robots.txt-Datei erstellt oder bearbeitet haben, ist es eine gute Idee, sie auf Fehler zu überprüfen. Ein kleiner Tippfehler könnte versehentlich wichtige Seiten für Suchmaschinen blockieren, daher ist dieser Schritt sehr wichtig! 👍

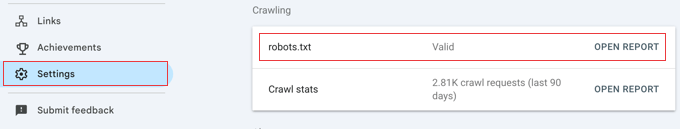

Während Google früher ein spezielles Testtool hatte, haben sie diese Funktion jetzt in die Hauptberichte der Google Search Console integriert.

Stellen Sie zunächst sicher, dass Ihre Website mit der Google Search Console verbunden ist. Wenn Sie dies noch nicht getan haben, folgen Sie einfach unserer einfachen Anleitung, wie Sie Ihre WordPress-Website zur Google Search Console hinzufügen.

Sobald Sie eingerichtet sind, gehen Sie zu Ihrem Google Search Console-Dashboard. Navigieren Sie im Menü unten links zu Einstellungen.

Suchen Sie als Nächstes den Abschnitt 'Crawling' und klicken Sie neben 'robots.txt' auf 'Bericht öffnen'.

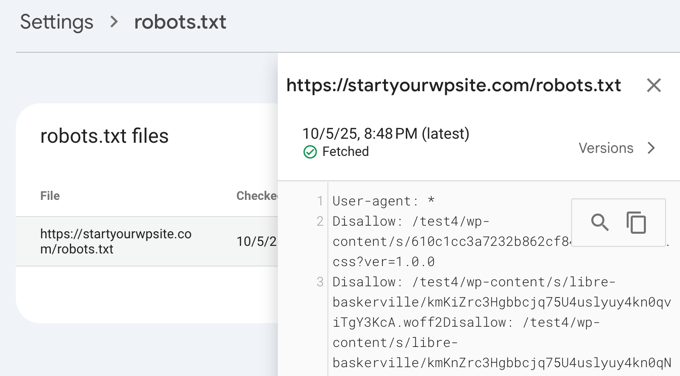

Klicken Sie einfach auf die aktuelle Version der Datei in der Liste.

Dieser Bericht zeigt Ihnen die aktuellste Version Ihrer robots.txt-Datei, die Google gefunden hat. Er hebt alle erkannten Syntaxfehler oder logischen Probleme hervor.

Machen Sie sich keine Sorgen, wenn Sie Ihre Datei gerade aktualisiert haben und die Änderungen hier nicht sofort sehen. Google prüft etwa einmal täglich automatisch auf eine neue Version Ihrer robots.txt-Datei.

Sie können diesen Bericht später erneut aufrufen, um zu bestätigen, dass Google Ihre letzten Änderungen übernommen hat und alles in Ordnung aussieht.

Es lohnt sich auch, Ihre robots.txt-Datei nach größeren Website-Änderungen erneut zu überprüfen, z. B. nach der Installation eines neuen Plugins, das ein öffentlich zugängliches Verzeichnis erstellt, nach der Änderung Ihrer Permalinks-Struktur oder nach der Migration einer Staging-Website in die Produktion.

Eine schnelle Überprüfung in diesem Bericht stellt jedes Mal sicher, dass nichts Wichtiges versehentlich blockiert wird.

Abschließende Gedanken

Das Ziel der Optimierung Ihrer robots.txt-Datei ist es, zu verhindern, dass Suchmaschinen Seiten crawlen, die nicht öffentlich zugänglich sind. Zum Beispiel Seiten in Ihrem wp-plugins-Ordner oder Seiten in Ihrem WordPress-Admin-Ordner.

Ein verbreiteter Mythos unter SEO-Experten ist, dass das Blockieren von WordPress-Kategorien, Tags und Archivseiten die Crawl-Rate verbessert und zu schnellerer Indexierung und höheren Rankings führt.

Das stimmt nicht. Tatsächlich wird diese Praxis von Google dringend abgeraten und verstößt gegen deren Best Practices, um ihnen beim Verständnis Ihrer Website zu helfen.

Wir empfehlen Ihnen, das obige robots.txt-Format zu befolgen, um eine robots.txt-Datei für Ihre Website zu erstellen.

Häufig gestellte Fragen zu WordPress robots.txt

Hier sind einige der häufigsten Fragen, die uns zur Optimierung der robots.txt-Datei in WordPress gestellt werden.

1. Was ist der Hauptzweck einer robots.txt-Datei?

Der Hauptzweck einer robots.txt-Datei ist die Verwaltung des Crawl-Budgets Ihrer Website. Indem Sie Suchmaschinen mitteilen, welche Seiten ignoriert werden sollen (wie Admin-Seiten oder Plugin-Dateien), helfen Sie ihnen, ihre Ressourcen effizienter für das Crawlen und Indexieren Ihrer wichtigsten Inhalte zu verwenden.

2. Wo befindet sich die robots.txt-Datei in WordPress?

Ihre robots.txt-Datei befindet sich im Stammverzeichnis Ihrer Website. Sie können sie normalerweise anzeigen, indem Sie in Ihrem Webbrowser zu IhreDomain.com/robots.txt navigieren.

3. Kann die Verwendung von robots.txt die Sicherheit meiner Website verbessern?

Nein, robots.txt ist keine Sicherheitsmaßnahme. Die Datei ist öffentlich sichtbar, sodass sie niemanden daran hindert, auf die von Ihnen aufgeführten URLs zuzugreifen. Sie gibt lediglich Anweisungen für gut funktionierende Suchmaschinen-Crawler.

4. Sollte ich WordPress-Kategorie- und Tag-Seiten in robots.txt blockieren?

Nein, Sie sollten Kategorie- und Tag-Seiten nicht blockieren. Diese Archivseiten sind für SEO nützlich, da sie Suchmaschinen helfen, die Struktur Ihrer Website zu verstehen und Ihre Inhalte zu entdecken. Das Blockieren kann sich negativ auf Ihre Suchrankings auswirken.

5. Was ist der Unterschied zwischen robots.txt und dem noindex-Tag?

Sie steuern unterschiedliche Dinge. Robots.txt steuert, ob ein Crawler eine URL überhaupt besuchen kann. Der noindex-Tag steuert, ob Suchmaschinen eine Seite in den Suchergebnissen auflisten, auch wenn sie sie bereits besucht haben.

Verwenden Sie robots.txt, um Crawler von Bereichen wie Ihrem Admin-Panel, Ihrer Staging-Umgebung oder Plugin-Verzeichnissen zu blockieren. Verwenden Sie noindex für Seiten, bei denen es Ihnen nichts ausmacht, dass Google sie crawlt, wie z. B. gefilterte Archivseiten oder Dankesseiten, die Sie einfach nicht in den Suchergebnissen anzeigen lassen möchten.

Eine wichtige Anmerkung: Das Blockieren einer URL in robots.txt entfernt sie nicht aus Googles Index, wenn sie bereits indexiert wurde. Zur Entfernung ist der noindex-Tag das richtige Werkzeug.

Zusätzliche Ressourcen zur Verwendung von robots.txt in WordPress

Jetzt, da Sie wissen, wie Sie Ihre robots.txt-Datei optimieren, möchten Sie vielleicht einige andere Artikel zum Thema robots.txt in WordPress lesen.

- Glossar: Robots.txt

- So verstecken Sie eine WordPress-Seite vor Google

- So verhindern Sie, dass Suchmaschinen eine WordPress-Website crawlen

- So löschen Sie eine WordPress-Website dauerhaft aus dem Internet

- So verstecken (Noindex) Sie PDF-Dateien in WordPress ganz einfach

- So beheben Sie den Fehler „Googlebot kann nicht auf CSS- und JS-Dateien zugreifen“ in WordPress

- Was ist llms.txt? Wie man llms.txt in WordPress hinzufügt

- So richten Sie All in One SEO für WordPress richtig ein (Ultimativer Leitfaden)

Wir hoffen, dieser Artikel hat Ihnen geholfen zu lernen, wie Sie Ihre WordPress robots.txt-Datei für SEO optimieren. Möglicherweise möchten Sie auch unseren ultimativen WordPress SEO-Leitfaden und unsere Expertenauswahl für die besten WordPress SEO-Tools sehen, um Ihre Website zu erweitern.

Wenn Ihnen dieser Artikel gefallen hat, abonnieren Sie bitte unseren YouTube-Kanal für WordPress-Video-Tutorials. Sie finden uns auch auf Twitter und Facebook.

Steve

Danke dafür – wie funktioniert das bei einer WP Multisite?

WPBeginner Support

Für ein Multisite-Netzwerk benötigen Sie eine robots.txt-Datei im Stammverzeichnis jeder einzelnen Website.

Admin

Pacifique Ndanyuzwe

Meine WordPress-Seite ist neu und meine robots.txt ist standardmäßig

user-agent: *

Disallow: /wp-admin/

Allow: /wp-admin/admin-ajax.php

Ich möchte, dass Google meine Inhalte durchsucht und indexiert. Ist diese robots.txt in Ordnung?

WPBeginner Support

Sie können das sicherlich verwenden, wenn Sie wollten

Admin

Ritesh Seth

Toller Artikel...

Ich war tagelang verwirrt wegen der Robots.txt-Datei und der Disallow-Links. Habe die Tags für die Robots-Datei kopiert. Ich hoffe, das löst das Problem meiner Website

WPBeginner Support

We hope our article will help as well

Admin

Kurt

Die Dateien in den Screenshots Ihres Home-Ordners befinden sich tatsächlich unter dem Ordner public_html in meinem Home-Ordner.

Ich hatte keinen /refer-Ordner unter meinem public_html-Ordner.

Ich hatte keine XML-Dateien für Beiträge oder Seiten irgendwo in meinem WP-Konto.

Ich habe einen Eintrag in die von mir erstellte robots.txt-Datei aufgenommen, um das Crawling meiner Sandbox-Website zu verhindern. Ich bin mir nicht sicher, ob das notwendig ist, da ich bereits die Option in WP ausgewählt habe, die besagt, dass Crawler meine Sandbox-Website nicht crawlen sollen, aber ich glaube nicht, dass es schadet, den Eintrag zu haben.

WPBeginner Support

Some hosts do rename public_html to home which is why you see it there. You would want to ensure Yoast is active for the XML files to be available. The method in this article is an additional precaution to help with preventing crawling your site

Admin

Ahmed

Toller Artikel

WPBeginner Support

Thank you

Admin

ASHOK KUMAR JADON

Hallo, so ein schöner Artikel, Sie haben mein Problem gelöst. Vielen Dank

WPBeginner Support

Glad our article could help

Admin

Elyn Ashton

User-agent: *

Disallow: /wp-admin/

Allow: /wp-admin/admin-ajax.php <– Das ist mein robot.txt-Code, aber ich bin verwirrt, warum mein /wp-admin indexiert wird? Wie kann ich es nicht indexieren?

WPBeginner Support

Wenn es zuvor indiziert wurde, müssen Sie möglicherweise warten, bis der Cache der Suchmaschine gelöscht ist

Admin

Ashish Kumar

Diese Website inspiriert mich wirklich, einen Blog zu starten. Vielen Dank, viel Team. Diese Website hat jeden einzelnen Artikel voller Informationen und Erklärungen. Wenn ich ein Problem habe, besuche ich zuerst diesen Blog. Danke

WPBeginner Support

Glad our articles can be helpful

Admin

Anna

Ich versuche, Roboter für meine Website mit Yoast zu optimieren. Allerdings gibt es in Yoast unter Tools keine Option für den 'Dateieditor'.

Es gibt nur zwei Optionen:

(i) Importieren und Exportieren

(ii) Massenbearbeitung

Können Sie mir bitte raten, wie dies behoben werden kann? Könnte es sein, dass ich eine kostenlose Version von Yoast benutze?

WPBeginner Support

Die kostenlose Version von Yoast hat immer noch die Option. Ihre Installation erlaubt möglicherweise keine Dateibearbeitung, in diesem Fall müssten Sie wahrscheinlich die FTP-Methode verwenden.

Admin

Emmanuel Husseni

Ich finde diesen Artikel wirklich hilfreich, weil ich nicht viel darüber weiß, wie robot.txt funktioniert, aber jetzt weiß ich es.

Bitte, was ich nicht verstehe, ist, wie finde ich das beste Format für robot.txt, das ich auf meiner Website verwenden kann (ich meine, eines, das allgemein funktioniert)?

Mir ist aufgefallen, dass viele große Blogs, die ich besuche, in den Suchmaschinenergebnissen weit oben ranken und unterschiedliche robot.txt-Formate verwenden.

Ich würde mich über eine Antwort von Ihnen oder von jemandem, der helfen kann, freuen.

Redaktion

Eine Sitemap zu haben und die Bereiche, die erlaubt werden müssen, zuzulassen, ist der wichtigste Teil. Der Disallow-Teil variiert je nach Website. Wir haben ein Beispiel in unserem Blogbeitrag geteilt, und das sollte für die meisten WordPress-Websites gut sein.

Admin

WPBeginner Support

Hallo Emmanuel,

Bitte sehen Sie sich den Abschnitt zur idealen robots.txt-Datei an. Es hängt von Ihren eigenen Anforderungen ab. Die meisten Blogger schließen WordPress-Admin- und Plugin-Ordner vom Crawling aus.

Admin

Emmanuel Husseni

Vielen Dank.

Jetzt verstehe ich. Ich denke, ich fange vorerst mit dem allgemeinen Format an.

Jack

Gut geschriebener Artikel, ich empfehle den Benutzern, eine Sitemap zu erstellen, bevor sie ihren ROBOTS-Text erstellen und aktivieren. Dies hilft Ihrer Website, schneller durchsucht und einfach indexiert zu werden.

Jack

Connie S Owens

Ich möchte verhindern, dass Suchmaschinen meine Archive während ihres Crawls indizieren.

Emmanuel Nonye

Vielen Dank, dieser Artikel war wirklich hilfreich

Cherisa

Ich erhalte weiterhin die unten stehende Fehlermeldung im Google Webmaster. Ich stecke im Grunde fest. Ein paar Dinge, die mir bei diesem Tutorial nicht klar waren, sind: Wo finde ich die Stammdateien meiner Website, wie stelle ich fest, ob ich bereits eine "robots.txt" habe und wie bearbeite ich sie?

WPBeginner Support

Hallo Cherisa,

Der Stammordner Ihrer Website ist derjenige, der Ordner wie wp-admin, wp-includes, wp-content usw. enthält. Er enthält auch Dateien wie wp-config.php, wp-cron.php, wp-blogheader.php usw.

Wenn Sie in diesem Ordner keine robots.txt-Datei sehen können, dann haben Sie keine. Sie können eine neue erstellen.

Admin

Cherisa

Vielen Dank für Ihre Antwort. Ich habe überall gesucht und kann diese Root-Dateien nicht finden, wie Sie beschreiben. Gibt es einen Pfadverzeichnis, dem ich folgen kann, der zu diesem Ordner führt? Wie z. B. unter Einstellungen usw.?

Devender

Ich hatte einen guten Web-Traffic auf meiner Website. Plötzlich fiel er im Mai auf Null. Bis jetzt habe ich das Problem. Bitte helfen Sie mir, meine Website wiederherzustellen.

Haris Aslam

Hallo, vielen Dank für diese Informationen, aber ich habe eine Frage.

Ich habe gerade die Sitemap.xml und die Robots.txt-Datei erstellt und sie werden gut gecrawlt. Aber wie kann ich "Product-Sitemap.xml" erstellen?

Es gibt eine vollständige Liste der Produkte in der sitemap.xml-Datei. Muss ich die Product-sitemap.xml separat erstellen?

und wieder bei Google oder Bing einreichen?

Können Sie mir bitte helfen?

Danke

Mahadi Hassan

Ich habe ein Problem mit der robots.txt-Dateieinstellung. Es wird nur eine robots.txt für alle Websites angezeigt. Bitte helfen Sie mir, separate robots.txt-Dateien für alle Websites anzuzeigen. Ich habe separate robots.txt-Dateien für jede einzelne Website. Aber nur eine robots.txt-Datei wird im Browser für alle Websites angezeigt.

Debu Majumdar

Bitte erklären Sie, warum Sie

Disallow: /refer/

in das Anfänger-Robots.txt-Beispiel aufgenommen haben? Ich verstehe die Auswirkungen dieser Zeile nicht. Ist das für Anfänger wichtig? Sie haben die beiden anderen verbotenen Zeilen erklärt.

Danke.

WPBeginner Support

Hallo Debu,

Dieses Beispiel stammt aus der robots.txt-Datei von WPBeginner. Bei WPBeginner verwenden wir ThirstyAffiliates, um Affiliate-Links zu verwalten und URLs zu verschleiern. Diese URLs enthalten /refer/, deshalb blockieren wir sie in unserer robots.txt-Datei.

Admin

Evaristo

Wie kann ich alle Tags/mydomain.Com auf nofollow setzen? In robots.txt, um den Link Juice zu konzentrieren? Danke.

harsh kumar

Hallo, ich bekomme einen Fehler in Yoast SEO bezüglich der Sitemap. Sobald ich auf „Fix it“ klicke, kommt er wieder. Meine Website-HTML wird nicht richtig geladen.

Tom

Ich habe gerade mein Google Webmaster Tools-Konto überprüft und über die Search Console Folgendes festgestellt:

Seite teilweise geladen

Nicht alle Seitenressourcen konnten geladen werden. Dies kann beeinflussen, wie Google Ihre Seite sieht und versteht. Beheben Sie Probleme mit der Verfügbarkeit von Ressourcen, die beeinflussen können, wie Google Ihre Seite versteht.

Dies liegt daran, dass alle CSS-Stylesheets, die mit Plugins verknüpft sind, von der Standard-robots.txt blockiert werden.

Ich verstehe gute Gründe, warum ich dies nicht einfach zulassen sollte, aber was wäre eine Alternative, da ich vermute, dass die Google-Algorithmen die Website dafür abstrafen, diese nicht zu sehen.

Suren

Hallo,

Immer wenn ich meine Website bei Google suche, erscheint dieser Text unter dem Link: „Eine Beschreibung für dieses Ergebnis ist nicht verfügbar, da die robots.txt dieser Website“

Wie kann ich dieses Problem lösen?

Mit freundlichen Grüßen

WPBeginner Support

Hallo Suren,

Es scheint, als hätte jemand versehentlich die Datenschutzeinstellungen Ihrer Website geändert. Gehen Sie zu Einstellungen » Lesen und scrollen Sie nach unten zum Abschnitt „Suchmaschinen-Sichtbarkeit“. Stellen Sie sicher, dass das Kontrollkästchen daneben nicht aktiviert ist.

Admin

Divyesh

Hallo

Wie ich im Webmaster-Tool gesehen habe, habe ich eine robots.txt-Datei wie folgt:

User-agent: *

Disallow: /wp-admin/

Allow: /wp-admin/admin-ajax.php

Lassen Sie mich wissen, ob das in Ordnung ist? Oder sollte ich etwas anderes verwenden?

John Cester

Ich möchte wissen, ob es eine gute Idee ist, „/wp-content/plugins/“ in robots.tx zu blockieren (zu verbieten)? Jedes Mal, wenn ich ein Plugin entferne, wird auf einigen Seiten dieses Plugins ein 404-Fehler angezeigt.

Himanshu Singh

Ich habe diese Erklärung geliebt. Als Anfänger war ich sehr verwirrt über die robot.txt-Datei und ihre Verwendung. Aber jetzt weiß ich, was ihr Zweck ist.

rahul

In einer robots.txt-Datei wurde index.php blockiert. Können Sie erklären, warum? Ist das eine gute Praxis?

Waleed Barakat

Danke, dass Sie diese wertvollen Informationen weitergegeben haben.

Awais Ahmed

Können Sie mir bitte sagen, warum das im Webmaster-Tool passiert:

Netzwerk nicht erreichbar: robots.txt nicht erreichbarWir konnten Ihre Sitemap nicht crawlen, da wir eine robots.txt-Datei im Stammverzeichnis Ihrer Website gefunden haben, sie aber nicht herunterladen konnten. Bitte stellen Sie sicher, dass sie zugänglich ist, oder entfernen Sie sie vollständig.

robots.txt Datei existiert, aber immer noch

Dozza

Interessantes Update vom Yoast-Team dazu unter

Zitat: „Die alten Best Practices, eine robots.txt zu haben, die den Zugriff auf Ihr wp-includes-Verzeichnis und Ihr Plugins-Verzeichnis blockiert, sind nicht mehr gültig.“

natveimaging

Allow: /wp-content/uploads/

Sollte das nicht so sein?

Disallow: /wp-content/uploads/

Weil Sie wissen, dass Google alle Ihre hochgeladenen Seiten als öffentliche URLs indizieren wird, richtig? Und dann erhalten Sie Fehler für die Seite selbst. Fehlt mir hier etwas?

nativeimaging

Insgesamt sind es die tatsächlichen Seiten, die Google crawlt, um Bildkarten zu generieren, NICHT die Upload-Ordner. Dann hätten Sie das Problem, dass alle kleineren Bildgrößen und andere Bilder, die für die Benutzeroberfläche bestimmt sind, ebenfalls indiziert werden.

Dies scheint die beste Option zu sein:

Disallow: /wp-content/uploads/

Wenn ich falsch liege, erklären Sie es mir bitte, damit ich Ihren Standpunkt hier verstehen kann.

Jason

Meine Blog-URL wird nicht indiziert. Muss ich meine robots.txt ändern? Ich benutze diese robots.txt

iyan

wie man eine robot txt erstellt, die NUR die Indexierung von Seiten und Beiträgen erlaubt.. danke

Simaran Singh

Ich bin mir nicht sicher, was das Problem ist, aber meine robots.txt hat zwei Versionen.

Eine unter http://www.example.com/robots.txt und die zweite unter example.com/robots.txt

Kann mir bitte jemand helfen! Lassen Sie mich wissen, was die mögliche Ursache sein könnte und wie ich sie beheben kann?

WPBeginner Support

Höchstwahrscheinlich erlaubt Ihr Webhoster den Zugriff auf Ihre Website sowohl über www als auch über Nicht-www-URLs. Versuchen Sie, robots.txt mit einem FTP-Client zu ändern. Untersuchen Sie sie dann von beiden URLs aus, wenn Sie Ihre Änderungen auf beiden URLs sehen können, bedeutet dies, dass es sich um dieselbe Datei handelt.

Admin

Simaran Singh

Danke für die schnelle Antwort. Das habe ich bereits getan, aber ich sehe keine Veränderung. Gibt es eine andere Möglichkeit, das Problem zu lösen?

Martin Conde

Yoasts blogpost about this topic was right above yours in my search so of course I checked them both. They are contradicting each other a little bit.. For example yoast said that disallowing plugin directories and others, might hinder the Google crawlers when fetching your site since plugins may output css or js. Also mentioned (and from my own experience), yoast doesn’t add anything sitemap related to the robots.txt, rather generates it so that you can add it to your search console. Here is the link to his post, maybe you can re-check because it is very hard to choose whose word to take for it

MM Nauman

Da ich nicht gut darin bin, diese Robotstxt-Datei zu erstellen, kann ich dann Ihre Robots.txt-Datei verwenden, indem ich die Parameter wie URL und Sitemap meiner Website ändere, ist das gut? Oder sollte ich eine andere erstellen?

Mohit Chauhan

Hallo,

Heute habe ich diese E-Mail von Google erhalten: „Googlebot kann nicht auf CSS- und JS-Dateien zugreifen“... was kann die Lösung sein?

Danke

Parmod

Lass mich raten... Du verwendest CDN-Dienste, um CSS- und JS-Dateien zu importieren. oder Es ist möglich, dass du eine falsche Syntax in diesen Dateien geschrieben hast.

Rahul

Ich habe eine Frage zum Hinzufügen von Sitemaps. Wie kann ich Yahoo und Bing Sitemap zur Robots-Datei und zum WordPress-Verzeichnis hinzufügen?

Gerbrand Petersen

Danke für die ausführliche Darstellung der Verwendung der robots-Datei. Weiß jemand, ob Yahoo auch diese robots.txt verwendet und ob sie die in der Datei genannten Regeln befolgt? Ich frage das, weil ich in meiner Datei ein „Disallow“ für eine bestimmte Seite habe, aber trotzdem Traffic von Yahoo auf dieser Seite erhalte. Nichts von Google, wie es sein sollte. Vielen Dank im Voraus.

Erwin

Korrektur...

„Wenn Sie das WordPress SEO-Plugin von Yoast oder ein anderes Plugin zur Generierung Ihrer XML-Sitemap verwenden, versucht Ihr Plugin, Ihre Sitemap-bezogenen Zeilen automatisch in die robots.txt-Datei einzufügen.“

Nicht wahr. WordPress SEO fügt die Sitemap nicht zur robots.txt hinzu

„Ich war immer der Meinung, dass die Verlinkung Ihrer XML-Sitemap aus Ihrer robots.txt ein wenig unsinnig ist. Sie sollten sie manuell zu Ihren Google und Bing Webmaster Tools hinzufügen und auf deren Feedback zu Ihrer XML-Sitemap achten. Das ist der Grund, warum unser WordPress SEO Plugin sie nicht zu Ihrer robots.txt hinzufügt.“

https://yoast.com/wordpress-robots-txt-example/

Empfehlenswerter ist auch, das Verzeichnis wp-plugins nicht zu sperren (Gründe siehe Yoasts Beitrag)

Und persönlich entferne ich gerne einfach die readme.txt-Datei…

Hyma

Ich habe die robots.txt-Datei und die Verwendung der robots-Datei verstanden. Was ist die Sitemap und wie erstelle ich eine Sitemap für meine Website?

Rick R. Duncan

Nach dem Lesen der Google-Dokumentation bin ich der Meinung, dass die zu verwendende Direktive in der robots.txt-Datei „disallow“ ist, die den Bots nur sagt, was sie crawlen können und was nicht. Sie sagt ihnen nicht, was indiziert werden kann und was nicht. Sie müssen das „noindex“-Robots-Meta-Tag verwenden, um eine Seite nicht zu indizieren.

Nitin

wirklich guter Artikel für eine SEO-optimierte robots.txt-Datei. Aber ich brauche eine Anleitung, wie man die robots.txt-Datei auf den Server hochlädt. Da es für Anfänger ein großes Problem zu sein scheint, diese Datei hochzuladen.

Übrigens, danke, dass Sie so nützliche Informationen geteilt haben.

-Nitin

Parmod

Laden Sie es auf Ihren Server/public_hmtl/(Ihr-Website-Name) ... in diesen Ordner hoch

Jenny

Was ist der beste Weg, um Code zu HTTacess hinzuzufügen, um mehrere Spam-Bot-Referrer für ihre URL und IP-Adresse zu blockieren, wenn keine URL angegeben ist

Ich weiß, wenn man eine falsche Syntax bei httacess hat, kann das die Website offline nehmen. Ich bin ein Anfänger und muss diese nervigen mehrfachen URLs aus Russland, China, der Ukraine usw. blockieren.

Vielen Dank

Hazel Andrews

Danke für diese Tipps... die robots.txt-Dateien wurden jetzt geändert! Juhu!

Rahat

Warum muss ich Allow: !!! hinzufügen?

Wenn ich nur erwähne, was Disallow sein muss, reicht das aus. Ich muss keinen Code für Allow schreiben, weil Googlebot oder Bingbot alles andere automatisch crawlen werden.

Warum sollte ich also Allow noch einmal verwenden?

Connor Rickett

Da das Fehlen der Robots.txt-Datei die Website nicht am Crawlen hindert, bin ich neugierig: Gibt es harte Daten darüber, wie sehr die Datei die SEO-Leistung verbessert?

Ich habe eine schnelle Google-Suche durchgeführt und keine quantitativen Daten dazu gefunden. Es gibt etwa eine halbe Million Artikel, die sagen: „Hey, das macht SEO besser!“, aber ich würde wirklich gerne wissen, worüber wir hier sprechen, auch allgemein.

Ist das ein 5% Boost? 50? 500?

WPBeginner Support

Suchmaschinen teilen solche Daten nicht mit. Das Fehlen einer robots.txt-Datei hindert Suchmaschinen nicht daran, eine Website zu crawlen oder zu indexieren. Es ist jedoch eine empfohlene Vorgehensweise.

Admin

Connor Rickett

Danke, dass Sie sich die Zeit genommen haben, mir zu antworten, ich weiß es zu schätzen!

JD Myers

Gutes Timing für diesen Artikel. Ich habe gestern versucht, diese Informationen zu finden.

Der Grund, warum ich danach gesucht habe, ist, dass Google Webmaster Tools mir mitteilte, dass sie meine Website nicht richtig crawlen konnten, weil ich verschiedene Ressourcen blockierte, die für das korrekte Rendern der Seite benötigt wurden.

Diese Ressourcen umfassten auch die, die sich in /wp-content/plugins/ befanden.

Nachdem ich diesen Ordner erlaubt hatte, verschwand die Warnung.

Irgendwelche Gedanken dazu?

WPBeginner Support

Sie können diese Warnungen getrost ignorieren. Es ist nur eine Warnung, wenn Sie tatsächlich Inhalte dort hätten, die Sie indiziert haben möchten. Manchmal haben Benutzer Suchbots eingeschränkt und es vergessen. Diese Warnungen sind in solchen Situationen nützlich.

Admin

Chetan Jadhav

Ich habe eine Frage, die viele Leute da draußen verwenden statische Sitemap, und Sie wissen, was sie haben WordPress-Website. Sollen wir statische oder von WordPress generierte Sitemap verwenden.

Wilton Calderon

Nett, ich mag die Art und Weise, wie Wpbeginner es hat, und mit diesem Rang in Alexa sieht es für mich wie der beste Weg aus, um robots.txt zu verwenden..

Brigitte Burke

Was bedeutet meine robots.txt-Datei, wenn sie so aussieht?

User-agent: * Disallow: /wp-admin/ Disallow: /wp-includes/ Disallow: /xmlrpc.php

Redaktion

Es besagt lediglich, dass Suchmaschinen Ihren wp-admin-Ordner, Ihren wp-includes-Ordner und die xml-rpc-Datei nicht indexieren sollten. Manchmal kann das Verweigern von /wp-includes/ bestimmte Skripte für Suchmaschinen blockieren, insbesondere wenn Ihre Website diese Skripte verwendet. Dies kann Ihrer SEO schaden.

Am besten gehen Sie zu Google Webmaster Tools und rufen Sie Ihre Website dort als Bot ab. Wenn alles einwandfrei geladen wird, müssen Sie sich keine Sorgen machen. Wenn dort steht, dass Skripte blockiert sind, möchten Sie vielleicht die Zeile wp-includes entfernen.

Admin

Herkules

Ich sehe keine Logik in Ihrer Idee, ein Skript im includes-Verzeichnis zu haben, das von einem Crawler / Roboter verwendet werden kann. Und zweitens, wenn es einen Einzelfall gibt, ist es besser, nachdem Sie das Standard-WordPress angegeben haben, erlauben Sie diese Datei, die Sie sich vorstellen, dass Suchmaschinen seine Skripte verwenden! Schließlich hat WordPress sicherlich nicht standardmäßig eine robots.txt gegen Suchmaschinen!!!!